浅谈专业的数据采集系统 从源头赋能数据价值

在当今的信息化时代,数据被誉为“新时代的石油”。未经提炼的原油无法直接驱动引擎,未经有效采集的原始数据也难以产生真正的价值。专业的数据采集系统,正是将海量、分散、异构的原始数据转化为高质量、可用、可信数据的“第一道炼油厂”,是构建数据驱动型组织的基石。

一、专业数据采集系统的核心价值

与零散、临时的数据收集行为不同,专业的数据采集系统是一套标准化、自动化、可管理的解决方案。其核心价值在于:

- 保障数据质量:通过预定义的清洗、校验、去重规则,从源头控制数据的准确性、完整性和一致性,避免“垃圾进,垃圾出”的困境。

- 提升效率与规模:自动化流程能够7x24小时不间断地从多个源头(如传感器、网站、数据库、API、日志文件)采集数据,处理海量信息,远超人工能力极限。

- 确保合规与安全:内置权限控制、审计日志和数据加密机制,确保采集过程符合GDPR等数据隐私法规,保护数据资产安全。

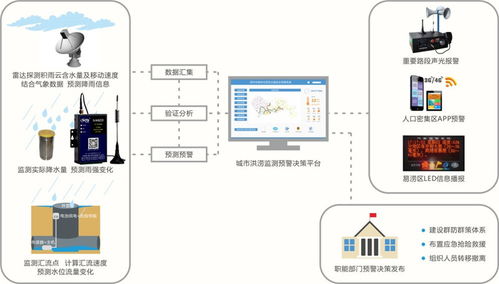

- 支撑实时决策:支持流式数据采集与处理,能够将实时产生的数据(如物联网设备数据、线上交易日志)快速导入分析系统,为实时监控和即时决策提供可能。

二、系统关键组成部分

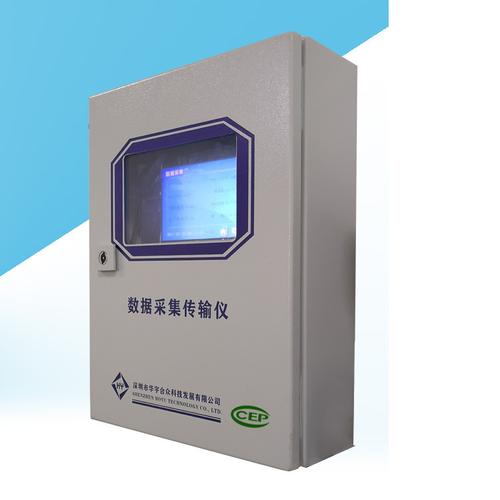

一个专业的数据采集系统通常包含以下关键模块:

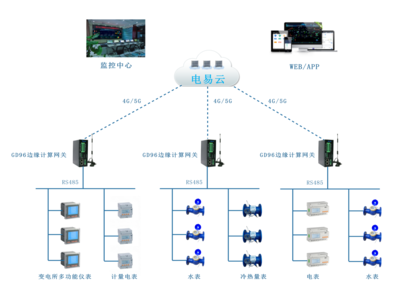

- 数据源连接器:适配各种数据源(关系数据库、NoSQL、云存储、SaaS应用、公开API、网络爬虫等)的接口或代理程序。

- 采集任务调度引擎:负责管理采集任务的周期、触发条件和执行顺序,支持定时、事件触发等多种模式。

- 数据处理流水线:在采集过程中或采集后立即进行数据清洗、格式转换、轻量级计算和富化。

- 数据传输与缓冲:高效可靠地将数据从源头传输至目标存储(如数据仓库、数据湖),常利用消息队列(如Kafka)应对流量峰值,保证数据不丢失。

- 监控与管理中心:提供可视化仪表盘,监控采集任务健康状态、数据流量、错误报警,并管理配置、权限和元数据。

三、主要技术形态与应用场景

根据数据特性和业务需求,数据采集系统呈现不同的技术形态:

- 批量采集:适用于对实时性要求不高的周期性数据同步,如每日凌晨同步前一天的交易数据到数据仓库。工具如Sqoop、DataX。

- 流式采集:用于处理连续不断产生的数据流,如实时监控网站点击流、工厂传感器数据。框架如Flink、Kafka Connect。

- 日志采集:集中收集分布在各个服务器上的应用程序日志和系统日志,用于运维分析和安全审计。代表工具有ELK Stack(Elasticsearch, Logstash, Kibana)中的Logstash和Fluentd。

- 网络爬虫系统:针对公开网页数据进行结构化提取,用于市场情报、舆情监控、价格比对等。需要处理反爬机制、动态渲染等复杂情况。

四、面临的挑战与发展趋势

构建与运营专业数据采集系统并非易事,面临着数据源变化频繁、接口不稳定、网络延迟、数据格式异构、海量数据吞吐等挑战。其发展呈现出以下趋势:

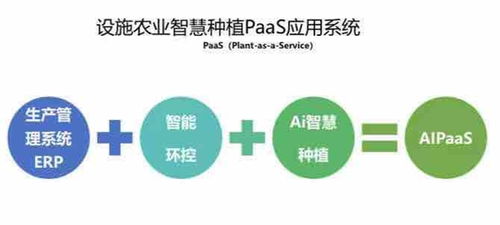

- 智能化:融入AI能力,实现数据源自动发现、schema自动推断、异常采集模式自动检测与修复。

- 云原生与Serverless化:基于容器、微服务和函数计算构建,实现弹性伸缩、高可用和更低运维成本。

- 端边云协同:在物联网场景下,采集架构向边缘延伸,在靠近数据源的设备端进行初步过滤和处理,再上传至云端,以降低带宽消耗和延迟。

- 数据血缘与可观测性增强:更精细地追踪数据从采集源头到最终消费端的完整链路,提升数据可信度和治理水平。

###

专业的数据采集系统远非简单的数据搬运工,而是一个集连接、治理、传输与监控于一体的战略性基础设施。它确保了数据供应链的源头活水是清澈、充沛且持续流动的。对于任何希望利用数据驱动创新、提升效率、优化决策的组织而言,投资建设一个稳健、高效、灵活的数据采集系统,都是迈出数字化转型至关重要且不可逾越的第一步。只有打好“采集”这根地基,上层的存储、分析、挖掘与智能应用大厦才能稳固屹立,释放数据的全部潜能。

如若转载,请注明出处:http://www.chuanqingkeji.com/product/72.html

更新时间:2026-05-28 03:05:27